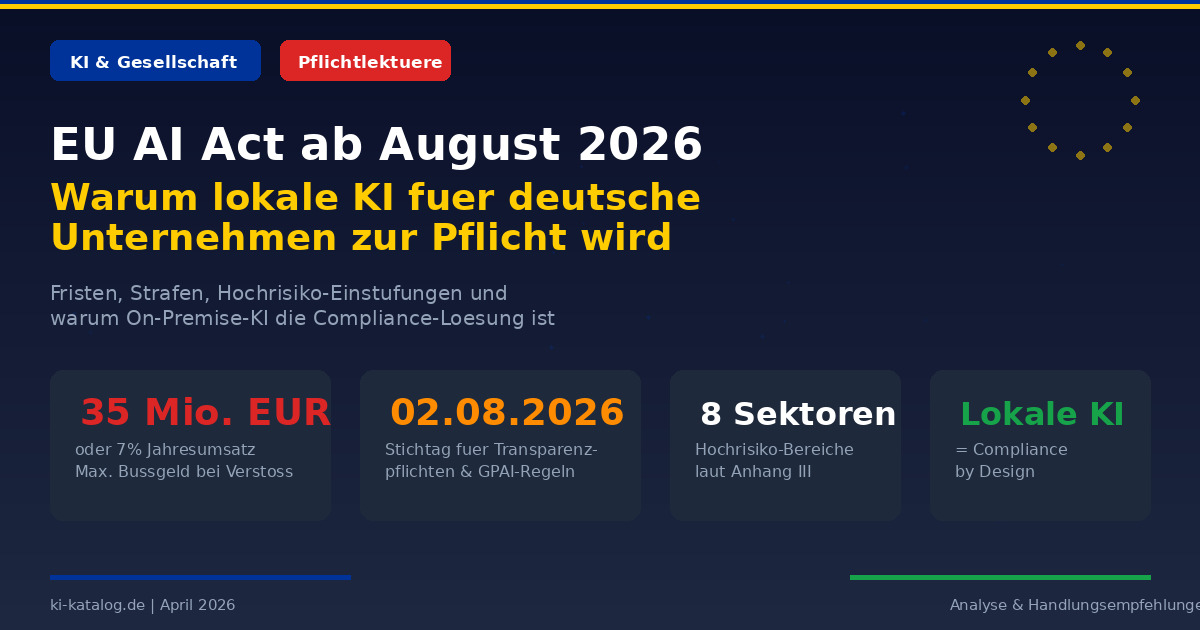

Ab dem 2. August 2026 greifen zentrale Pflichten des EU AI Act — darunter Transparenzanforderungen, GPAI-Regeln und die Durchsetzungsbefugnisse des KI-Büros. Gleichzeitig laufen die Vorbereitungsfristen für Hochrisiko-KI-Systeme. Für deutsche Unternehmen, die Cloud-basierte KI-Dienste von US-Anbietern nutzen, wird die Compliance-Lage damit dramatisch komplexer. Dieser Artikel analysiert, was konkret gilt, welche Strafen drohen und warum lokale KI-Modelle zur strategisch wichtigsten Antwort auf das regulatorische Umfeld werden.

1. Der EU AI Act im Überblick: Ein gestaffeltes Regelwerk

Der EU AI Act — offiziell die Verordnung (EU) 2024/1689 — ist seit dem 1. August 2024 in Kraft und wird schrittweise anwendbar. Das Gesetz folgt einem risikobasierten Ansatz: Je höher das Risiko eines KI-Systems für Gesundheit, Sicherheit oder Grundrechte, desto strenger die Anforderungen. Die Staffelung sieht wie folgt aus:

- Seit 2. Februar 2025: Verbote für inakzeptable KI-Praktiken (z. B. Social Scoring, manipulative Techniken, ungezieltes Scraping für Gesichtserkennungsdatenbanken)

- Seit 2. August 2025: Pflichten für Anbieter von General Purpose AI (GPAI) — also Basismodellen wie GPT-4, Claude, Gemini oder Llama. Dazu gehören technische Dokumentation, Urheberrechtskonformität und Transparenzvorgaben

- Ab 2. August 2026: Transparenzpflichten nach Artikel 50, volle Durchsetzungsbefugnisse des KI-Büros und — ursprünglich — die Hochrisiko-Pflichten

- Voraussichtlich ab 2. Dezember 2027: Hochrisiko-Pflichten für eigenständige Systeme nach Anhang III (verschoben durch den Digital Omnibus)

- Voraussichtlich ab 2. August 2028: Hochrisiko-Pflichten für KI in regulierten Produkten nach Anhang I

- KI-generierte Inhalte: Texte, Bilder, Audio- und Videoinhalte, die von KI erzeugt wurden, müssen maschinenlesbar als solche gekennzeichnet werden

- Deepfakes: Manipulierte Bild-, Audio- oder Videoinhalte müssen klar als künstlich erzeugt oder verändert gekennzeichnet sein

- Chatbots und Emotionserkennung: Nutzer müssen darüber informiert werden, dass sie mit einem KI-System interagieren bzw. dass eine Emotionserkennung stattfindet

- Biometrische Identifizierung: Fernidentifikation, biometrische Kategorisierung, Emotionserkennung

- Kritische Infrastruktur: Management von Wasser-, Gas-, Strom- und digitalen Netzen

- Bildung und Berufsbildung: Zugangsentscheidungen zu Bildungseinrichtungen, Prüfungsbewertung

- Beschäftigung und Personalmanagement: Bewerbungsscreening, Leistungsbewertung, Beförderungsentscheidungen

- Wesentliche öffentliche und private Dienstleistungen: Kreditwürdigkeit, Versicherungsprämien, Notdienst-Priorisierung

- Strafverfolgung: Risikoeinschätzung, Lügendetektoren, Beweisbewertung

- Migration und Asyl: Antragsbearbeitung, Risikobewertung an Grenzen

- Rechtspflege und demokratische Prozesse: Unterstützung bei Gerichtsentscheidungen, Wahlbeeinflussung

- Anhang-III-Systeme (eigenständige Hochrisiko-KI): Verschiebung vom 2. August 2026 auf den 2. Dezember 2027 — ein Plus von 16 Monaten

- Anhang-I-Systeme (KI in regulierten Produkten): Verschiebung auf den 2. August 2028

- Die Bundesnetzagentur wird zur federführenden Aufsichtsbehörde für KI

- Nationale Sanktionsmechanismen werden etabliert — die EU-Bußgeldrahmen werden in deutsches Recht überführt

- Es gibt spezielle Regelungen für KMU, darunter vereinfachte Dokumentationspflichten und regulatorische Sandboxes

- Die Zusammenarbeit zwischen Bundesnetzagentur und Datenschutzaufsichtsbehörden wird formalisiert — wichtig, weil AI Act und DSGVO sich in vielen Bereichen überschneiden

- KI-Inventar erstellen: Erfassen Sie alle KI-Systeme, die in Ihrem Unternehmen im Einsatz sind — auch die, die Mitarbeiter eigenständig nutzen (Shadow AI). Erstellen Sie eine vollständige Liste mit Anbieter, Einsatzzweck und betroffenen Datenarten

- Risikoeinstufung durchführen: Prüfen Sie für jedes System, ob es unter die Hochrisiko-Kategorie fällt. Nutzen Sie die acht Sektoren aus Anhang III als Checkliste

- KI-Kompetenz schulen: Die Kompetenzpflicht nach Artikel 4 gilt ab August 2026. Beginnen Sie jetzt mit Schulungsprogrammen und dokumentieren Sie die Teilnahme

- Transparenzpflichten umsetzen: Kennzeichnen Sie KI-generierte Inhalte, informieren Sie Nutzer über KI-Interaktionen und implementieren Sie Deepfake-Markierungen

- Shadow AI eindämmen: Sperren Sie den Zugang zu privaten KI-Tools im Firmennetz und stellen Sie eine sichere, unternehmenseigene KI-Infrastruktur bereit

- Auftragsverarbeitungsverträge prüfen: Stellen Sie sicher, dass für jeden Cloud-KI-Dienst ein DSGVO-konformer AVV vorliegt

- Lokale KI evaluieren: Prüfen Sie, welche Anwendungsfälle auf lokale Open-Source-Modelle migriert werden können. Besonders bei Hochrisiko-Anwendungen ist der Compliance-Vorteil erheblich

- Hardware beschaffen: Planen Sie die Hardware-Infrastruktur für lokale KI. Moderne Modelle wie Llama 4, Mistral Large oder Gemma 4 laufen bereits auf Consumer-GPUs wie der RTX 3090 oder RTX 4090

- Dokumentation aufbauen: Beginnen Sie mit der technischen Dokumentation, dem Risikomanagementsystem und den Qualitätsmanagementprozessen für Hochrisiko-Systeme — auch wenn die Frist voraussichtlich auf Dezember 2027 verschoben wird

- Post-Market-Monitoring einrichten: Etablieren Sie Prozesse zur kontinuierlichen Überwachung Ihrer KI-Systeme und zur Meldung schwerwiegender Vorfälle (15-Tage-Frist!)

- Rot (nur lokal): Personenbezogene Daten, Bewerbungsunterlagen, Gesundheitsdaten, Geschäftsgeheimnisse, Finanzdaten

- Gelb (Cloud mit AVV): Allgemeine Geschäftskommunikation, nicht-sensible Dokumente, öffentlich verfügbare Informationen

- Grün (Cloud möglich): Allgemeines Brainstorming, kreative Texte, Code-Unterstützung ohne proprietären Code

- Europäische Kommission — Regulatory Framework on AI (offizielle Seite)

- ADVISORI — EU AI Act Hochrisiko: Pflichten bis August 2026

- Paperclipped — EU Digital Omnibus AI Act Zeitplan: Hochrisiko-Frist verschoben

- TÜV Rheinland Consulting — EU AI Act 2026: Zwischenstand

- von Rueden — EU AI Act: Was ab August 2026 für deutsche Unternehmen gilt

- activeMind.legal — Geplante Änderungen der KI-Verordnung (Digital Omnibus)

- Sage — EU AI Act 2026 für den Mittelstand: Fristen, Pflichten und Compliance

- Eagle LSP — Hochrisiko-KI & Anhang III: Einstufung nach der KI-VO

- BDO — Synergien zwischen KI-Verordnung und DSGVO

- EU AI Act — Annex III: High-Risk AI Systems (Volltext)

- The Decoder

- heise online: Künstliche Intelligenz

- t3n Magazin

- Offizielle Ankündigungen der genannten Unternehmen

2. Was genau gilt ab August 2026?

Der 2. August 2026 ist kein einzelner Stichtag, sondern markiert mehrere parallel greifende Regelungen:

Transparenzpflichten (Artikel 50)

Anbieter und Betreiber bestimmter KI-Systeme müssen ab diesem Datum umfassende Transparenz gewährleisten. Das betrifft insbesondere:

GPAI-Enforcement

Die volle Durchsetzung der GPAI-Regeln durch das europäische KI-Büro beginnt. Das bedeutet: Informationsanfragen, Modellzugang für Prüfungen und im Extremfall Modellrückrufe werden möglich. Bußgelder von bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes können verhängt werden.

KI-Kompetenzpflicht (Artikel 4)

Oft übersehen, aber enorm relevant: Ab August 2026 müssen Unternehmen sicherstellen, dass alle Mitarbeiter, die KI-Systeme bedienen oder überwachen, über ein ausreichendes Maß an KI-Kompetenz verfügen. Das bedeutet konkret: Schulungsprogramme, dokumentierte Weiterbildung und Nachweise über die KI-Literacy der Belegschaft.

3. Die Bußgelder: Empfindlicher als die DSGVO

Der EU AI Act etabliert ein dreistufiges Sanktionssystem, das in seiner Maximalhöhe die DSGVO-Bußgelder übertrifft:

| Verstoßkategorie | Maximum | Beispiele |

|---|---|---|

| Verbotene Praktiken | 35 Mio. EUR / 7 % Umsatz | Social Scoring, manipulative KI, biometrische Massenüberwachung |

| Hochrisiko-Pflichten | 15 Mio. EUR / 3 % Umsatz | Fehlende Dokumentation, kein Risikomanagementsystem, mangelnde Human Oversight |

| Falsche Angaben | 7,5 Mio. EUR / 1 % Umsatz | Unrichtige Informationen an Behörden, fehlende Meldungen |

Entscheidend: Die Bußgelder berechnen sich auf Basis des weltweiten Konzernumsatzes — nicht des Umsatzes in einem einzelnen Land. Für einen mittelständischen Konzern mit 500 Millionen Euro Jahresumsatz bedeutet die Höchststufe ein Bußgeld von bis zu 35 Millionen Euro. Selbst die niedrigste Stufe liegt bei 5 Millionen Euro.

Zusätzlich zu Bußgeldern sind weitere Maßnahmen möglich: Marktrücknahme des KI-Systems, Betriebsuntersagung und öffentliche Warnungen — letztere können den Reputationsschaden über den finanziellen Verlust hinaus vervielfachen.

4. Hochrisiko-KI: Was fällt darunter?

Der AI Act definiert Hochrisiko-KI-Systeme über zwei Wege:

Weg 1: Sicherheitskomponenten in regulierten Produkten (Anhang I)

KI-Systeme, die als Sicherheitskomponenten in bereits regulierten Produkten eingesetzt werden — etwa Medizinprodukte, Maschinen, Spielzeug, Aufzüge, Fahrzeuge oder Luftfahrtsysteme. Diese unterliegen bereits bestehenden CE-Zertifizierungsprozessen, die um KI-spezifische Anforderungen erweitert werden.

Weg 2: Eigenständige Hochrisiko-Systeme (Anhang III)

Acht Sektoren sind explizit benannt:

Die Praxis-Relevanz für Unternehmen: Wer KI im HR-Bereich einsetzt (Bewerbungsfilter, Performance-Reviews), Kreditscoring betreibt oder KI-gestützte Kundensegmentierung für Versicherungen nutzt, fällt mit hoher Wahrscheinlichkeit unter die Hochrisiko-Kategorie.

5. Der Digital Omnibus: Atempause — aber kein Freifahrtschein

Am 19. November 2025 veröffentlichte die Europäische Kommission den Digital Omnibus on AI — einen Änderungsvorschlag, der die Durchsetzungsfristen für Hochrisiko-KI-Systeme verschiebt:

Warum die Verschiebung? Die europäischen Normungsorganisationen CEN und CENELEC haben die harmonisierten Standards, die für die Konformitätsbewertung benötigt werden, schlicht noch nicht fertiggestellt. Ohne diese Standards können Unternehmen keine rechtssichere Konformitätsbewertung durchführen — ein klassisches Henne-Ei-Problem.

Achtung: Der Digital Omnibus befindet sich derzeit im Trilog-Verfahren zwischen Europäischem Parlament, Rat und Kommission. Die zyprische Ratspräsidentschaft strebt eine Einigung bis Mai 2026 an. Die Verschiebung ist also noch nicht final beschlossen, gilt aber als sehr wahrscheinlich.

Und selbst wenn die Hochrisiko-Fristen verschoben werden: Die Transparenzpflichten, GPAI-Regeln und KI-Kompetenzanforderungen gelten trotzdem ab August 2026. Unternehmen, die jetzt nichts tun und auf die Verschiebung setzen, gehen ein gefährliches Spiel ein.

6. Das deutsche KI-MIG: Nationale Umsetzung

Deutschland hat im Februar 2026 das KI-Maßnahmen- und Innovationsgesetz (KI-MIG) verabschiedet. Es regelt die nationale Marktüberwachung und die Durchsetzung des EU AI Act in Deutschland. Zentrale Punkte:

7. Warum Cloud-KI zum Compliance-Risiko wird

Für deutsche Unternehmen, die ChatGPT, Claude API, Gemini oder andere Cloud-basierte KI-Dienste nutzen, ergibt sich eine doppelte Compliance-Herausforderung: Der EU AI Act trifft auf die bestehenden DSGVO-Anforderungen — und beide zusammen machen Cloud-KI von US-Anbietern zu einem regulatorischen Minenfeld.

Problem 1: Datentransfer in Drittstaaten

Wenn Mitarbeiter Kundendaten, Bewerbungsunterlagen oder Geschäftsgeheimnisse in ChatGPT, Claude oder Gemini eingeben, fließen diese Daten an Server von US-Unternehmen. Trotz des EU-US Data Privacy Framework bleibt ein Restrisiko: Der US CLOUD Act erlaubt US-Behörden den Zugriff auf Daten, die von US-Unternehmen gespeichert werden — auch wenn die Server in der EU stehen. Das Schrems-II-Urteil des EuGH hat gezeigt, wie fragil transatlantische Datentransfer-Abkommen sind.

Problem 2: Keine Kontrolle über Trainingsdaten

Bei Cloud-KI-Diensten haben Unternehmen keine Kontrolle darüber, ob ihre Eingaben für das Training des Modells verwendet werden. Zwar bieten Anbieter wie OpenAI und Anthropic mittlerweile Enterprise-Versionen an, die keine Trainingsdaten-Nutzung versprechen — aber die vertragliche Zusicherung ist schwer zu verifizieren, und ein Verstoß wäre für das Unternehmen praktisch nicht nachweisbar.

Problem 3: Fehlende Dokumentation und Auditierbarkeit

Der AI Act verlangt für Hochrisiko-Systeme eine lückenlose technische Dokumentation, die zehn Jahre aufbewahrt werden muss. Bei Cloud-KI-Diensten kontrolliert der Anbieter die Modellarchitektur, die Trainingsdaten und die Inferenz-Pipeline. Unternehmen, die diese Dienste als Betreiber nutzen, können die geforderte Dokumentation oft schlicht nicht erstellen, weil ihnen der Einblick fehlt.

Problem 4: Shadow AI

Studien zeigen, dass in vielen Unternehmen bereits 40-60 % der Mitarbeiter KI-Tools privat im Arbeitskontext nutzen — oft ohne Wissen der IT-Abteilung. Dieses "Shadow AI"-Phänomen ist das KI-Äquivalent zur Shadow IT und stellt ein unkontrollierbares Compliance-Risiko dar: Wenn ein Mitarbeiter Bewerbungsunterlagen in sein privates ChatGPT-Konto kopiert, liegt ein DSGVO-Verstoß und potenziell ein AI-Act-Verstoß vor — und das Unternehmen haftet.

8. Lokale KI als Compliance-Strategie: Die Lösung liegt auf der Hand

Vor diesem Hintergrund wird verständlich, warum immer mehr deutsche Unternehmen auf lokale KI-Modelle setzen. Der Grundgedanke: Wenn das Modell auf eigener Hardware läuft und keine Daten das Unternehmen verlassen, fallen viele der oben beschriebenen Compliance-Probleme weg — von Haus aus.

Vorteil 1: Volle Datensouveränität

Bei lokaler KI verlassen keine Daten den eigenen Server. Es gibt keinen Datentransfer in Drittstaaten, kein CLOUD-Act-Risiko und keine Abhängigkeit von der Datenschutzpolitik eines US-Konzerns. Die DSGVO-Konformität ist "by Design" gegeben, weil die Verarbeitung ausschließlich im eigenen kontrollierten Bereich stattfindet.

Vorteil 2: Vollständige Dokumentierbarkeit

Unternehmen kennen bei lokalen Modellen die exakte Modellversion, die Konfiguration, die Eingabe- und Ausgabedaten. Sie können jeden Inferenz-Vorgang protokollieren, Audit-Trails erstellen und die geforderte technische Dokumentation lückenlos führen — eine Voraussetzung, die bei Cloud-Diensten praktisch unmöglich ist.

Vorteil 3: Human Oversight wird umsetzbar

Der AI Act fordert, dass kompetente Personen Hochrisiko-KI-Systeme beaufsichtigen und Entscheidungen übersteuern können. Bei lokalen Systemen ist das technisch umsetzbar: Man kann Schwellenwerte definieren, ab denen das System eine menschliche Überprüfung erzwingt, Ausgaben vor der Weitergabe prüfen lassen und granulare Berechtigungen vergeben.

Vorteil 4: Kein Vendor-Lock-in

Wer auf Open-Source-Modelle wie Llama, Mistral, Gemma oder Qwen setzt, ist nicht von einem einzelnen Anbieter abhängig. Wenn ein Modell Sicherheitslücken aufweist oder regulatorische Probleme bekommt, kann es innerhalb von Stunden durch ein anderes ersetzt werden — ohne Vertragsverhandlungen, ohne Datenmigration.

Vorteil 5: Betroffenenrechte leichter erfüllbar

Die DSGVO garantiert Betroffenen das Recht auf Auskunft, Löschung und Berichtigung. Bei lokaler KI liegen alle verarbeiteten Daten im eigenen Zugriff. Löschanfragen können technisch garantiert umgesetzt werden — während bei Cloud-Diensten oft unklar bleibt, ob und wann Daten tatsächlich gelöscht werden.

9. Praxisbeispiele: So setzen deutsche Unternehmen lokale KI ein

Beispiel 1: Mittelständischer Personaldienstleister

Ein Personaldienstleister mit 200 Mitarbeitern nutzt KI zur Vorauswahl von Bewerbungen — ein klarer Hochrisiko-Anwendungsfall nach Anhang III. Die Lösung: Ein lokal betriebenes Llama-Modell, das auf einem Server mit NVIDIA RTX 4090 läuft. Der gesamte Screening-Prozess ist dokumentiert, jede Entscheidung nachvollziehbar, und kein Bewerberdokument verlässt das Firmennetz. Die Konformitätsbewertung wird dadurch erheblich vereinfacht.

Beispiel 2: Versicherungsunternehmen

Eine Versicherung nutzt KI für die Schadensbearbeitung und Risikobewertung. Da Versicherungsentscheidungen direkt Auswirkungen auf den Zugang zu wesentlichen Dienstleistungen haben, ist das ein Hochrisiko-Bereich. Durch den Einsatz lokaler Modelle kann das Unternehmen jeden einzelnen Entscheidungspfad dokumentieren, Bias-Prüfungen auf den eigenen Trainingsdaten durchführen und die geforderten Post-Market-Monitoring-Prozesse intern abbilden.

Beispiel 3: Kommunalverwaltung

Eine Stadtverwaltung setzt KI für die Bearbeitung von Bürgeranfragen ein. Bürgerdaten dürfen unter keinen Umständen an US-Server übertragen werden. Ein lokal betriebenes Modell — etwa Mistral oder Gemma — ermöglicht den KI-Einsatz bei vollständiger Datenhoheit. Die Transparenzpflicht wird durch einen automatischen Hinweis ("Diese Antwort wurde KI-unterstützt erstellt") erfüllt.

10. Konkrete Handlungsempfehlungen: Was Sie jetzt tun sollten

Sofort (April – Juni 2026)

Kurzfristig (Juni – August 2026)

Mittelfristig (Q3 2026 – Q2 2027)

11. Die Kosten der Compliance — und der Non-Compliance

Die Implementierung eines lokalen KI-Systems kostet einen Bruchteil der potenziellen Bußgelder:

| Position | Kosten (ca.) |

|---|---|

| Server mit RTX 4090 (24 GB VRAM) | 3.000 – 5.000 EUR |

| Dual-GPU-Server (2x RTX 3090, 48 GB VRAM) | 4.000 – 7.000 EUR |

| Einrichtung und Konfiguration (intern/extern) | 2.000 – 10.000 EUR |

| Stromkosten pro Jahr (Dauerbetrieb) | 1.500 – 3.000 EUR |

| Gesamtinvestition Jahr 1 | 8.000 – 25.000 EUR |

Zum Vergleich: Das Mindestbußgeld bei einem Hochrisiko-Verstoß liegt bei 7,5 Millionen Euro. Die Investition in lokale KI-Infrastruktur amortisiert sich also nicht nur über die Compliance, sondern auch über den Wegfall von Cloud-KI-Abonnementkosten, die bei Enterprise-Plänen schnell 20.000 – 100.000 EUR pro Jahr erreichen.

12. Die Bitkom-Perspektive: Hybridansatz als Königsweg

Laut einer Bitkom-Studie bevorzugen 58 % der deutschen Unternehmen einen Hybridansatz: Sensible Datenverarbeitung erfolgt lokal, während generische Aufgaben (z. B. allgemeine Textgenerierung, Zusammenfassungen, Brainstorming) weiterhin über Cloud-Dienste laufen.

Dieser pragmatische Ansatz ergibt Sinn: Nicht jeder KI-Einsatz ist hochriskant, und nicht jede Anfrage enthält sensible Daten. Der Schlüssel liegt in einer klaren Datenklassifizierung:

Fazit: Handeln, nicht abwarten

Der EU AI Act ist kein fernes Zukunftsszenario — er ist geltendes Recht, und zentrale Pflichten greifen in weniger als vier Monaten. Die Verschiebung der Hochrisiko-Fristen durch den Digital Omnibus verschafft zwar Luft bei der Konformitätsbewertung, aber die grundlegenden Transparenz-, Kompetenz- und GPAI-Anforderungen gelten ab August 2026 ohne Ausnahme.

Für deutsche Unternehmen, die KI nutzen oder planen, KI einzusetzen, ist lokale KI nicht mehr nur eine technische Alternative — sie wird zur regulatorischen Notwendigkeit. Die Kombination aus EU AI Act und DSGVO macht Cloud-basierte US-KI-Dienste für sensible Anwendungsfälle zunehmend problematisch, während lokale Modelle Compliance by Design bieten.

Die gute Nachricht: Die technologische Entwicklung spielt Unternehmen in die Hände. Open-Source-Modelle wie Llama 4, Mistral, Gemma 4 und Qwen haben ein Qualitätsniveau erreicht, das für die meisten Unternehmensanwendungen mehr als ausreichend ist. Die Hardware-Anforderungen sind überschaubar, und die Einrichtung ist mit Tools wie Ollama oder LM Studio in wenigen Stunden möglich.

Wer jetzt handelt, hat einen Wettbewerbsvorteil. Wer abwartet, riskiert Bußgelder, Reputationsschäden und den Verlust von Kundenvertrauen.

Quellen

Tipp: Auf KI-Katalog.de finden Sie einen umfassenden Überblick über lokale KI-Modelle mit Fähigkeiten-Matrix, Hardware-Empfehlungen und DSGVO-Bewertungen für über 1.400 KI-Tools. Ideal als Ausgangspunkt für Ihre KI-Compliance-Strategie.

---

Quellen: